La prochaine étape sera de construire un nouveau DC dans le Noooooooorrrrrrrd pour perdre 1 ou 2°C comparé à Paris et voir...

Ce que je comprends pas c'est que peu d'opérateurs télécom penchent à se rapprocher des pays scandinaves pour y placer des DC de cold storage par exemple...

La latence est important car elle permet de gagner du temps pour le chargement des pages web et mettre à datacenter dans le nord de la France, c'est 4 à 5ms de perdues pour une grand majorité de client, car il n'y a pas de point de peering réellement utilisé à Lille (Je ne remet pas en cause LilleIX, mais si il y a 10 Gb/s de trafic ils seraient content). Et quand un grand acteur demande un 100 Gb/s à OVH sur le CIV, le TH2 local où est implèmenté LilleIX, le a réponse d'OVH, c'est qu'ils ne savent pas faire.

En incluant dorénavant la réponse d'arnaud, si cela coûte actuellement 2 à 3 fois moins cher, il faudra pas que les canicules durent de 2 à 3 fois plus longtemps qu'en 2018...

J'ai un peu discuté sur ce qui réduit la durée de vie des serveurs, avec Arnaud, mais aussi avec Lionel (Maxnod) et c'est :

- Les variations de température

- Les poussières

DC5 sera un datacenter fiable, le doute n'est pas permis, au vu des température passées.

Si il fait 40°c 24h/24 365 jours par an, cela ne posera aucun problème à DC5, la température sera la même que si il fait -30°c dehors : 30°c dans l'allée froide.

Pour le risque de condensation,j'ai beaucoup interrogé Arnaud sur ce point, il faut absolument éviter une variation trop rapide de la température pour que l'humidité dans l'air lié au refroidissement adiabatique condense sur un matériel plus froid que l'air.

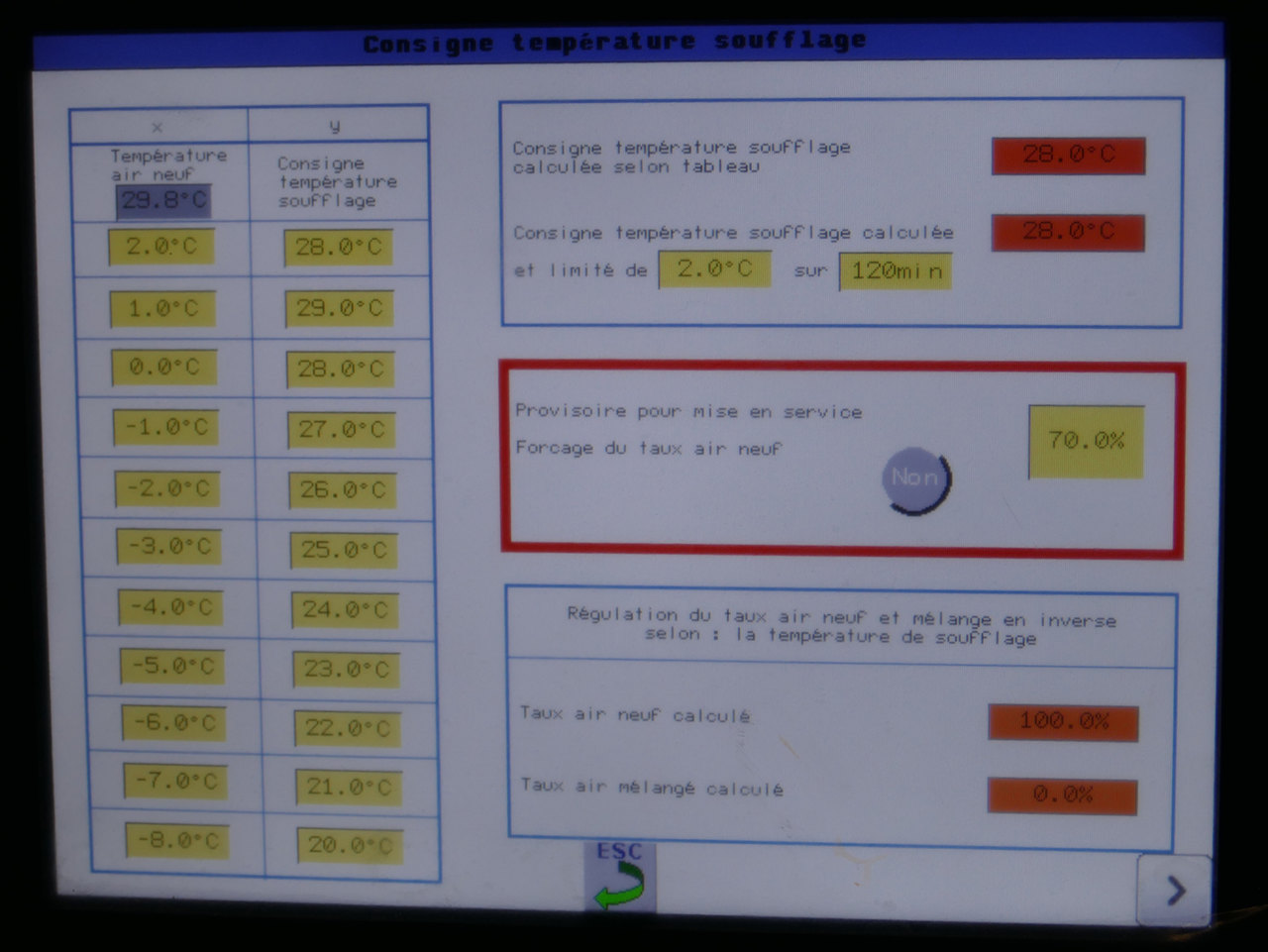

L’automate a une protection, pour limiter les changements brusques de température et éviter que de la condensation ne se forme : celui-ci ajuste la température de consigne de soufflage au gré de la température extérieure. Celle-ci est limitée à 1 degrés C. par heure, indiqué sous forme d’une limite de 2°C par 120 minutes sur l’automate :

Là où on a vu des problème de fiabilité du matériel, la température fait le yoyo... 'Toutes les barrettes de ram sont tombées en panne en même temps'

Je pense que c'est pas limité à Gravelines, car j'ai un serveur à Roubaix où la température monte bien aussi.

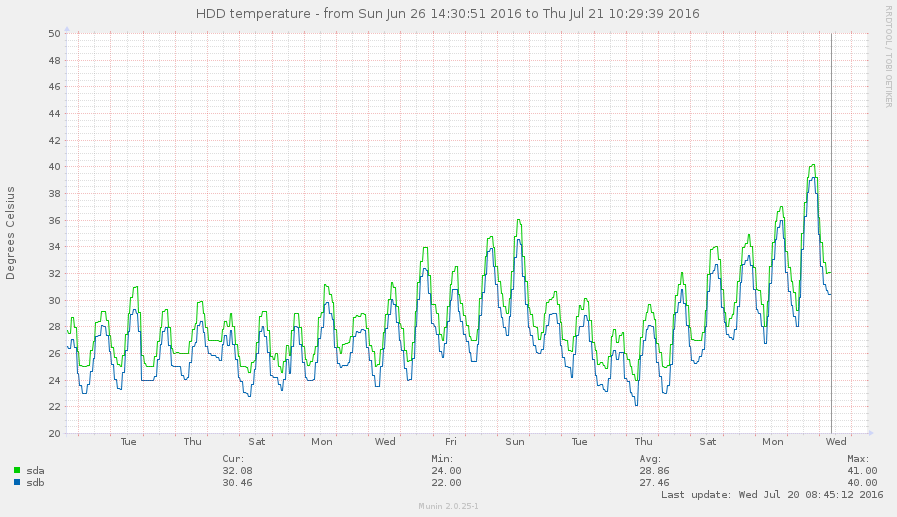

Graphique de la sonde du disque dur également, entre le 26 juin et aujourd'hui.

Là, ce graphique m'inquiète vraiment! Plus de 18°C de variation de température, c'est énorme.

Je croyais que les disques durs étaient surtout sensible aux variations de température.

Et on voit qu'il n'y a aucune régulation. Ca semble être la température extérieure. Du coup, est-ce qu'on a des données sur la température en hiver?

Leon.